Quel est le plus grand risque posé par l'IA ? Alors que beaucoup pointeraient du doigt le système financier, il serait préférable de concentrer notre attention davantage sur les marchés du travail.

Les inquiétudes financières sont certes compréhensibles. Même en 2026, le spectre de 2008 hante toutes les discussions sur les risques économiques. Lorsque Lehman Brothers s’est effondré et que le système bancaire mondial a vacillé, les gouvernements ont dû faire face à un choix crucial : renflouer les banques avec l’argent public ou assister à l’implosion du système financier. Aux États-Unis, les décideurs politiques ont opté pour le renflouement, encourageant ainsi la prise de risques futurs et provoquant la colère des contribuables qui en ont supporté le coût.

Mais les régulateurs américains ont ensuite passé la décennie suivante à mettre en place une nouvelle ligne de défense, désormais intégrée à l’architecture bancaire mondiale. Ce faisant, ils ont proposé une feuille de route pour faire face aux risques systémiques qui s’accumulent actuellement au sein du secteur de l’IA.

Certes, le Conseil de stabilité financière (CSF) prévient que les cadres réglementaires destinés à surveiller l’IA en sont encore à leurs balbutiements. Mais les risques restent gérables. Le secteur de l’IA est arrivé à un tournant qui devrait sembler familier à quiconque se souvient du système financier d’avant 2008. La concentration du marché est extrême, les interconnexions entre les principaux acteurs sont profondes, et l’infrastructure critique du secteur passe par des points de défaillance uniques.

Avant 2008, on supposait que le risque au sein du système financier était largement réparti. Ce n’était pas le cas. L’effet de levier était dissimulé dans des véhicules hors bilan, les expositions de contrepartie étaient opaques, et la défaillance d’une seule institution pouvait se répercuter de manière imprévisible sur l’ensemble du système. La réglementation était dispersée entre de nombreuses entités, dont aucune n’avait une vue d’ensemble de ce qui se passait. Les régulateurs ne disposaient d’aucun cadre pour appréhender les risques systémiques, ni d’aucun moyen de déterminer quelles entreprises entraîneraient la faillite d’autres entités en cas de défaillance.

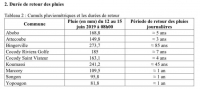

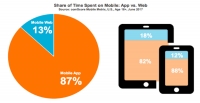

Le secteur de l'IA connaît un problème de concentration similaire. Selon Menlo Ventures, trois entreprisesseulement — Anthropic, OpenAI et Google — contrôlent environ 88 % du marché des grands modèles linguistiques destinés aux entreprises. Et la couche matérielle est encore plus concentrée, TSMC dominant complètement la fabrication de semi-conducteurs à nœuds avancés, ce qui soulève des inquiétudes quant à un éventuel goulot d'étranglement mondial en matière de puissance de calcul. Lorsqu'un séisme de magnitude 7,4 a frappé Taïwan en avril 2024, il a temporairement perturbé la production de semi-conducteurs et rappelé au monde à quel point cette infrastructure est devenue géographiquement concentrée.

Heureusement, l’innovation centrale de la réglementation financière post-2008 s’est avérée efficace : identifier les institutions dont la faillite serait catastrophique, et leur imposer de détenir une capacité totale d’absorption des pertes (TLAC) suffisante — fonds propres et dette à long terme pouvant faire l’objet d’une dépréciation — pour faire faillite en toute sécurité. Les résultats sont clairs. Une analyse du Congressional Research Service sur les faillites bancaires aux États-Unis montre une forte baisse des faillites à la suite des réformes réglementaires post-crise.

Bien qu'aucun des outils introduits après la crise financière ne s'applique directement à l'IA (les banques détiennent des actifs financiers qui peuvent être évalués et soumis à des tests de résistance, tandis que les systèmes d'IA reposent sur des données d'apprentissage, des poids de modèles et une capacité de calcul), la logique réglementaire sous-jacente reste valable. Les régulateurs n'ont qu'à envisager trois adaptations.

La première concerne la désignation et la divulgation des entités d'importance systémique.Les régulateurs et les organismes de normalisation devraient identifier quels fournisseurs d’IA, quelles plateformes cloud et quels fabricants de puces sont devenus des infrastructures critiques pour le système financier. Le rapport du FSB d’octobre 2025 surla surveillance de l’IAreconnaissait que les institutions financières dépendent de plus en plus d’un petit nombre de grands fournisseurs de technologies pour leurs capacités d’IA, mais que les efforts de surveillance en sont encore à un « stade précoce », en raison de lacunes dans les données et d’un manque de taxonomies standardisées. Remédier à cela est la première étape.

Deuxièmement, les exigences en matière de résilience opérationnelle devraient servir de substitut aux réserves de fonds propres. Au lieu de se conformer aux exigences de fonds propres TLAC, les fournisseurs d’IA d’importance systémique devraient démontrer leur redondance, leur capacité de basculement et leur véritable substituabilité. Les entreprises financières qui s’appuient sur un seul fournisseur d’IA devraient être soumises à des limites de concentration analogues aux règles d’exposition qui empêchent les banques d’accorder des prêts trop importants à une seule contrepartie. Laboîte à outils du FSB pour la gestion et la surveillance des risques liés aux tiersfournit déjà un cadre ; les régulateurs devraient l’utiliser de manière plus proactive.

Troisièmement, nous avons besoin de tests de résistance pour les défaillances corrélées induites par l’IA. Le Comité européen du risque systémique avertit que, comme les modèles d’IA sont « limités par l’historique » — formés sur des données passées —, ils sont intrinsèquement peu aptes à prédire des événements extrêmes en dehors de leur distribution d’apprentissage. C’est précisément le type de risque lié aux modèles que les tests de résistance sont conçus pour révéler. Les régulateurs devraient élaborer des scénarios de crise spécifiques à l’IA — la défaillance d’un grand fournisseur de cloud, un choc réglementaire affectant un modèle dominant, ou une perturbation géopolitique des chaînes d’approvisionnement en puces — et exiger des institutions financières utilisant l’IA dans des fonctions critiques qu’elles démontrent leur capacité à absorber ce choc.

Heureusement, les défaillances liées à l’IA ne déclencheraient pas nécessairement une crise financière du type de celle de 2008. Si les régulateurs agissent avec l’urgence requise, le risque financier systémique potentiel lié à l’IA est gérable.

Mais l’impact de l’IA sur les personnes qui travaillent pour gagner leur vie constitue un défi plus profond et bien plus lourd de conséquences. L’ampleur du remplacement potentiel de la main-d’œuvre par l’IA n’est plus hypothétique. IBM a remplacé des centaines de personnes dans son service des ressources humaines, où l’IA gère désormais 94 % des tâches routinières ; Salesforce a réduit ses embauches pour les postes d’ingénierie et de service client ; et le PDG de Shopify a déclaré que les nouvelles embauches ne seraient approuvées que si les responsables du recrutement pouvaient démontrer que l’IA n’est pas en mesure d’effectuer le travail.Le rapport « Future of Jobs Report 2025» du Forum économique mondial prévoit que 39 % des compétences fondamentales des travailleurs seront bouleversées d’ici 2030, et McKinsey & Company estime que la moitié des activités professionnelles actuelles pourraient être automatisées entre 2030 et 2060.

Que faut-il faire ? Bien que des recherches de la Harvard Kennedy School suggèrent que la reconversion vers des professions exposées à l’IA puisse entraîner des pertes de revenus substantielles, ce n’est pas une raison pour abandonner cette solution. D’autres pays, tels que le Danemark et Singapour, ont largement investi dans la formation, et leurs programmes fonctionnent bien.

Quoi qu'il en soit, il est essentiel d'impliquer les employeurs, car les programmes de formation doivent doter les travailleurs des compétences qui sont recherchées aujourd'hui et qui seront nécessaires à l'avenir. Il est crucial de garantir l'accès au haut débit et à une formation aux compétences numériques.

Les régulateurs disposent des outils nécessaires pour prévenir une crise financière liée à l'IA. Mais nous avons encore besoin que les décideurs politiques s'engagent sérieusement à faire en sorte que la révolution de l'IA profite à tous, et pas seulement aux quelques-uns qui possèdent les technologies sous-jacentes.

By Lenny Mendonca and Martin Neil Baily

JDF TV

L'actualité en vidéo

JDF TV

L'actualité en vidéo