Il y a quelques années encore, lIA semblait nêtre quun simple gadget : un chatbot qui simulait lintelligence en assemblant des phrases complètes en réponse aux demandes des utilisateurs, mais qui, en fin de compte, nétait guère plus sophistiqué quun moteur de recherche avancé. Pourtant, aujourdhui, elle sest révélée être un outil incroyable, capable daccomplir des tâches que je naurais jamais cru possibles de mon vivant.

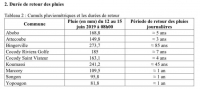

Par exemple, j’ai utilisé l’IA pour localiser des ensembles de données en ligne, les manipuler, effectuer des tests statistiques et produire des tableaux et des graphiques soignés, accompagnés de commentaires pertinents sur la signification des résultats, leur lien avec la littérature scientifique, ainsi que les forces et les faiblesses de l’analyse. En moins d’une demi-heure, l’IA peut accomplir un travail qui prendrait plusieurs jours à un assistant de recherche.

Parfois, les modèles d’IA actuels semblent presque capables de lire dans vos pensées. Contrairement à la programmation ou à l’écriture de code, vous n’avez pas besoin de préciser très exactement ce que vous recherchez, ce qui ne laisse aucune place à l’interprétation erronée. Le modèle « devinera » ce que vous recherchez et complétera les détails manquants (même s’il vaut mieux toujours les vérifier, comme peuvent en témoigner les cabinets d’avocats qui ont déposé des mémoires générés par l’IA contenant des citations fictives). Ou, à défaut, l’interface vous guidera jusqu’à ce que vous ayez clarifié votre requête.

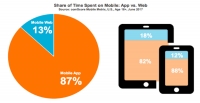

Il est réconfortant de penser que l’IA pourrait être un outil qui nous aidera tous à devenir plus productifs et plus performants dans notre travail. Elle m’a certainement rendu plus efficace dans mes recherches. Elle réduit les coûts des entrepreneurs en fournissant des services de marketing et de conseil à moindre coût. Elle permet aux agents de service client débutants de bénéficier des compétences et de l’expérience de leurs supérieurs. Elle permet enfin aux travailleurs indépendants ou aux artisans de fournir des services plus sophistiqués et techniquement plus exigeants.

Contrairement à de nombreuses technologies antérieures, l’IA est particulièrement bien placée pour aider les personnes moins qualifiées et moins éduquées — les travailleurs occupant les échelons inférieurs de l’économie. En dotant chacun d’entre nous de capacités accrues, elle offre des avantages qui sont potentiellement les plus significatifs pour ceux qui souffrent des plus grands désavantages initiaux. Cela signifie qu’elle pourrait fonctionner très différemment de, disons, l’automatisation, dont l’objectif principal est de remplacer les travailleurs à la chaîne ou dans les tâches de vente ou administratives.

La crainte, bien sûr, est que l'IA fasse bien plus que cela, avec des conséquences incertaines. Pour l’instant, je considère que le choix et la formulation des questions de recherche relèvent de ma prérogative et constituent la principale source de mon avantage concurrentiel. À un moment donné, je peux imaginer être tenté de demander à l’IA de générer les questions elle-même. En fait, les outils d’IA que j’utilise m’y incitent déjà. À la fin d’un exercice du type de celui que j’ai esquissé ci-dessus, ils me suggèrent gentiment d’autres pistes d’analyse fructueuses que je pourrais explorer.

L’IA se substitue à la réflexion d’autres manières, plus subtiles. Elle façonne déjà ma façon de concevoir la recherche existante. Non seulement elle résume ce qui existe, mais elle m’indique également comment les recherches connexes s’articulent avec mon travail et comment je devrais les appréhender. Elle établit des liens entre différentes parties de la littérature auxquels je n’avais pas pensé.

C’est là que réside le plus grand danger. Le débat public sur l’impact de l’IA sur la société se concentre principalement sur le risque de remplacement des travailleurs et la perte d’emplois. Un risque encore plus grand est le remplacement de la pensée humaine. Lorsque nous laissons l’IA penser à notre place, nous franchissons un seuil important. Notre capacité collective à penser se dégrade, tout comme notre motivation à apprendre à penser. Comme la frontière entre l’application de la pensée à un problème et la pensée elle-même est déjà floue, elle est facilement franchie.

Dans un article récent très intéressant, Daron Acemoglu, Dingwen Kong et Asuman Ozdaglar, du MIT, formalisent une intuition sur la manière dont un tel transfert cognitif peut produire des résultats catastrophiques. Ils se demandent ce qui se passe lorsque les modèles d’IA deviennent très performants pour fournir le type de connaissances spécifiques au contexte qui peuvent aider les gens à accomplir les tâches précises auxquelles ils s’attellent. De tels résultats permettraient aux gens d’obtenir de meilleurs résultats, même en apprenant moins.

Il y a toutefois là un problème, car la connaissance a une externalité importante. En réfléchissant à la manière de résoudre mon problème, je contribue également au stock général de connaissances sur la façon dont les autres peuvent résoudre les leurs. Lorsque j’investis moins dans mon propre apprentissage, le stock général de connaissances en pâtit. Dans le cas limite, dystopique, la connaissance générale disparaît complètement.

Certes, il ne s'agit pour l'instant que d'une possibilité théorique, et selon les hypothèses que l'on formule sur l'intensité des effets concurrents, de meilleurs résultats sont également possibles. Le danger est pourtant réel. Lorsque nous laissons l'IA apprendre et réfléchir à notre place, nous dégradons nos propres capacités humaines — et risquons à terme de détruire la base de connaissances sur laquelle l'IA elle-même repose.

Pour répondre à ces enjeux, il faudra élaborer des normes sociales et professionnelles sur l’utilisation appropriée de l’IA. Par exemple, les chercheurs pourraient devoir inclure des informations détaillées sur la manière dont ils ont utilisé l’IA — un processus qui pourrait être automatisé par les outils d’IA eux-mêmes —, les décisions de publication et de promotion étant fortement orientées vers les produits de l’esprit humain. Des organisations telles que le Partnership on AI peuvent contribuer à l’élaboration et à la diffusion de principes généraux. Nous aurons également besoin de nouvelles formes de réglementation gouvernementale, comme l’a exigé pratiquement toute nouvelle technologie.

Une condition nécessaire à ces solutions est une nouvelle façon de penser l’IA. Avant tout, le discours public a besoin d’un cadre différent. La question dont nous devrions débattre n’est pas ce que l’IA va nous faire, mais ce que nous voulons qu’elle fasse pour nous.

Par Dani Rodrik

JDF TV

L'actualité en vidéo

JDF TV

L'actualité en vidéo