Au début du mois, les Émirats arabes unis ont annoncé un plan visant à faire fonctionner la moitié de leurs services publics grâce à une IA agentique dici deux ans. Dans le cadre de ce projet, lIA est censée servir de « partenaire exécutif » qui « analyse, décide, exécute et saméliore en temps réel » sans intervention humaine. Ayant passé notre carrière à la croisée de lentrepreneuriat, de la recherche et de la politique numérique, nous pouvons affirmer sans hésitation que ce projet est imprudent. Comme les Émirats arabes unis se présentent comme un modèle numérique mondial, dautres gouvernements se sentiront poussés à suivre leur exemple.

C'est un danger que nous ne devons pas ignorer. Nous savons déjà ce qui se passe lorsque les gouvernements délèguent la prise de décision à des algorithmes. En 2021, un système d'auto-apprentissage aux Pays-Bas a accusé à tort environ 35 000 familles de fraude aux allocations familiales. Des parents ont été condamnés à rembourser des dizaines de milliers d'euros qu'ils ne devaient pas ; des foyers ont été perdus ; et plus de 2 000 enfants ont été placés sous la tutelle de l'État.

Ce résultat était en réalité intégré dès la conception du système. La double nationalité et les noms à consonance étrangère étaient signalés comme des facteurs de risque, ce qui a directement ancré une discrimination illégale dans le modèle. Il en a résulté un scandale national qui a finalement conduit à la démission du gouvernement de Mark Rutte, alors Premier ministre.

Une dynamique similaire s’est produite en Australie. Entre 2015 et 2019, le programme Robodebt a poursuivi 433 000 bénéficiaires de l’aide sociale pour 1,7 milliard de dollars australiens (1,2 milliard de dollars) de dettes prétendument illégales. Les conséquences ont été dramatiques, des mères ayant témoigné que leurs fils s’étaient suicidés après avoir reçu des avis de dette qu’ils n’avaient aucun moyen de contester. Une commission royale a par la suite conclu que le programme n’était « ni équitable ni légal ».

Aux États-Unis, quant à eux, l’Arkansas et l’Idaho ont remplacé des infirmières par des algorithmes pour évaluer l’éligibilité et les niveaux de soins à domicile. Les personnes atteintes de paralysie cérébrale, de tétraplégie et de sclérose en plaques ont vu leurs soins réduits de 20 à 50 % du jour au lendemain. Les tribunaux ont finalement ordonné l’arrêt de l’utilisation de ces systèmes, mais pas avant que le mal ne soit fait. Certains patients se sont retrouvés sans soutien adéquat, ce qui a entraîné des complications médicales qui auraient pu être évitées.

Chacun de ces cas concernait un seul système au sein d’une seule agence. Imaginez maintenant que de tels systèmes gèrent la moitié de tous les services publics, comme le propose le plan des Émirats arabes unis.

Prenons, par exemple, le cas d’une mère célibataire dont les allocations de garde d’enfants sont gelées après qu’un agent IA a signalé son activité bancaire, la laissant se débattre dans une procédure d’appel qui la renvoie d’un système automatisé à un autre, sans aucun interlocuteur humain, juste au moment où son loyer arrive à échéance. Qu'en est-il d'un travailleur migrant dont le renouvellement de permis de séjour est refusé parce que le système ne parvient pas à analyser les documents fournis par son employeur — le rendant de fait sans papiers — ou d'une veuve âgée dont la pension est suspendue parce que deux bases de données sont en conflit et qu'elle ne parvient pas à comprendre l'interface ?

Ce ne sont pas des hypothèses. Ce sont des schémas avérés que l'IA agentique intensifie d'une manière qu'aucun programme de formation ne peut résoudre dans le délai de deux ans fixé par les Émirats arabes unis.

Trois risques majeurs se dégagent. Le premier est l’ampleur : lorsqu’un agent humain commet une erreur, une seule personne en souffre ; lorsqu’un agent IA en commet une, des milliers de personnes peuvent être affectées avant même que quiconque ne s’en aperçoive.

Vient ensuite l’opacité de la prise de décision de l’IA. Étant donné que les systèmes agents prennent des décisions en séquence, chaque étape s’appuyant sur la précédente, la chaîne causale est de fait perdue au moment où le préjudice devient visible. Le système algorithmique de prestations de santé de l’Arkansas en offre un exemple frappant. Personne — pas même ses créateurs — ne pouvait expliquer pleinement son fonctionnement, ce qui a conduit un tribunal fédéral à le qualifier de « totalement irrationnel ». De plus, un manque de transparence peut être inhérent aux secrets commerciaux ou aux cadres propriétaires sous-jacents aux algorithmes.

Enfin, les systèmes d’IA renversent la charge de la preuve, obligeant les citoyens à prouver leur innocence plutôt que d’exiger de l’État qu’il justifie ses actions. Comme l’ont montré le scandale des allocations de garde d’enfants aux Pays-Bas et le programme Robodebt en Australie, ce sont ceux qui en sont le moins capables – les personnes disposant de peu de temps, d’argent, de compétences linguistiques et d’accès à une aide juridique – qui sont les plus durement touchés.

Les Émirats arabes unis affirment que le principe directeur de leur programme d’IA est « les personnes d’abord ». Sa conception suggère toutefois le contraire. Un gouvernement qui évalue les ministères en fonction de la « rapidité d’adoption » et de la « maîtrise de l’IA » ne se concentre pas sur ce qui compte, mais reproduit la même logique d’efficacité qui a déjà causé des dommages considérables à travers le monde.

La vitesse d’adoption est un indicateur propre aux fournisseurs. Or, la responsabilité fondamentale d’un gouvernement réside dans un devoir de diligence fondé sur le jugement humain.

Cela correspond aux attentes des citoyens, qui souhaitent que le gouvernement soit responsable et transparent, et qu’il explique les décisions qui affectent leurs droits et libertés. Lorsque les gouvernements adoptent avec enthousiasme la prise de décision autonome au nom de l’efficacité, ils renoncent en fait à cette responsabilité.

Chaque scandale lié aux algorithmes de ces dernières années a soulevé les mêmes questions fondamentales : qui est aux commandes, et qui a pris la décision ? Dans un gouvernement dirigé par une IA autonome, ces questions n’ont plus de réponses claires. Le système décide, se met à jour et passe à autre chose, laissant les citoyens sans recours lorsque les choses tournent mal.

Avec l’avènement de l’IA, la responsabilité démocratique s’érode non pas par une prise de pouvoir ouverte, mais par une série de décisions d’achat qui supplantent discrètement le contrôle humain. En sapant la confiance dans les institutions à un moment où celle-ci est déjà dangereusement faible, ces systèmes servent en fin de compte les intérêts des géants de la technologie qui mènent la révolution de l’IA.

Il n'est pourtant pas nécessaire qu'il en soit ainsi. Les Émirats arabes unis disposent des ressources, des talents et de la stabilité politique nécessaires pour bâtir un gouvernement numérique véritablement centré sur l'humain, capable d'établir la norme mondiale en augmentant, plutôt qu'en remplaçant, la prise de décision humaine.

Les coûts d'un échec ne se limiteront pas aux Émirats arabes unis. Ils seront supportés par une mère célibataire dans un autre pays dont les allocations sont réduites par un algorithme dont elle ignorait l'existence, et par d'innombrables autres personnes comme elle à travers le monde.

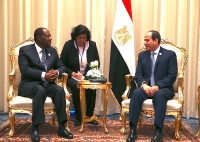

Par Gabriela Ramos et Emilija Stojmenova Duh

JDF TV

L'actualité en vidéo

JDF TV

L'actualité en vidéo